Akamai Luncurkan AI Grid Untuk Tekan Latensi dan Biaya Komputasi

- Akamai meluncurkan AI Grid, platform cloud yang mendistribusikan pemrosesan AI ke lebih dari 4.400 lokasi edge global untuk menekan latensi dan biaya komputasi.

- Teknologi ini memanfaatkan orkestrasi cerdas guna menempatkan beban kerja AI secara otomatis antara edge, regional, dan pusat data, menciptakan efisiensi serta respons cepat bagi aplikasi real-time.

- Akamai menggabungkan jaringan edge dengan GPU NVIDIA berkapasitas besar dan telah menarik kontrak infrastruktur AI senilai US$200 juta dari sektor gaming, perbankan, media, dan ritel.

Jakarta, FORTUNE – Perusahaan teknologi, Akamai meluncurkan AI Grid, platform berbasis cloud yang mendistribusikan pemrosesan AI ke lebih dari 4.400 lokasi edge global. Langkah ini menandai pergeseran strategi industri dari model AI terpusat ke arsitektur terdistribusi yang lebih efisien dan responsif.

Melalui Akamai Inference Cloud, perusahaan kini dapat menjalankan inferensi AI lebih dekat ke pengguna, sehingga mengurangi latensi sekaligus menekan biaya komputasi. Teknologi ini memanfaatkan orkestrasi cerdas untuk menempatkan beban kerja AI secara otomatis antara edge, regional, dan pusat data.

“Pabrik AI telah dirancang khusus untuk beban kerja pelatihan dan model terdepan — dan infrastruktur terpusat akan terus memberikan tokenomics terbaik untuk kasus penggunaan tersebut,” kata Adam Karon, Chief Operating Officer dan General Manager, Cloud Technology Group, Akamai dalam keterangannya, Kamis (26/3).

Video real-time, AI fisik, dan pengalaman personalisasi dengan tingkat koneksi yang sangat tinggi menuntut proses inferensi di titik kontak, bukan melalui perjalanan berulang ke klaster terpusat. Orkestrasi cerdas AI Grid Akamai dinilai memberikan cara bagi pabrik AI untuk memperluas inferensi ke luar — dengan memanfaatkan arsitektur terdistribusi yang sama seperti yang telah merevolusi pengiriman konten untuk mengarahkan beban kerja AI ke 4.400 lokasi, dengan biaya yang tepat, pada waktu yang tepat.

Secara bisnis, pendekatan ini menjawab kebutuhan baru pasar, terutama untuk aplikasi real-time seperti gaming, layanan keuangan, media, dan ritel, yang menuntut respons dalam hitungan milidetik.

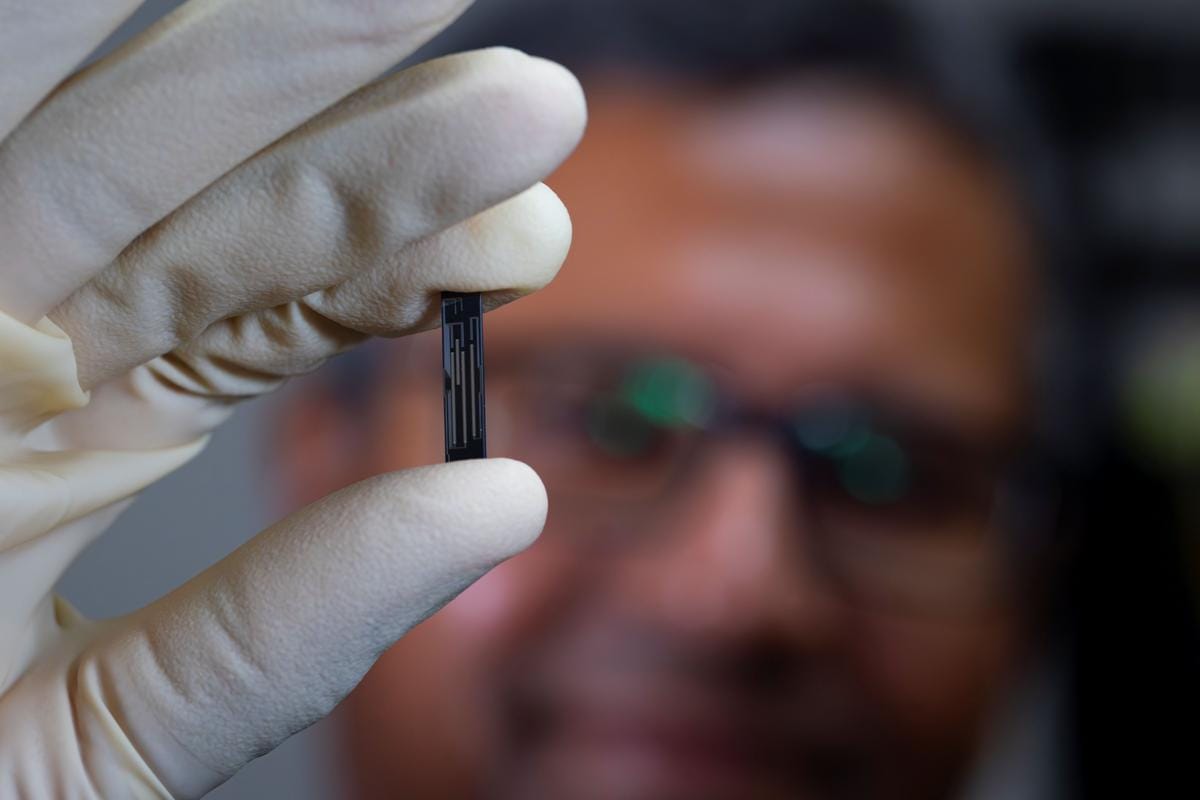

Akamai juga mengkombinasikan jaringan edge dengan klaster GPU NVIDIA berkapasitas besar untuk menangani beban kerja AI berat, menciptakan model hybrid antara komputasi terpusat dan terdistribusi.

Perusahaan mengklaim pendekatan ini dapat menurunkan biaya inferensi melalui alokasi komputasi yang lebih efisien, mempercepat waktu respons AI dengan pemrosesan di titik pengguna dan meningkatkan skalabilitas global untuk aplikasi berbasis AI.

“Aplikasi AI-native yang baru membutuhkan latensi yang dapat diprediksi dan efisiensi biaya yang lebih baik dalam skala global,” kata Chris Penrose, Global VP - Business Development – Telco, NVIDIA.

Permintaan terhadap solusi ini mulai terlihat, dengan adopsi di sektor gaming, perbankan, media, dan ritel, serta kontrak infrastruktur AI senilai US$200 juta dari pelanggan korporat.

Dengan strategi ini, Akamai memposisikan diri sebagai pemain kunci dalam gelombang baru infrastruktur AI, seiring pergeseran fokus industri dari pelatihan model ke deploy dan monetisasi AI secara real-time.